2400 VJET MË VONË, KJO ENIGMË E SOKRATIT BLLOKON CHATGPT DHE SFIDON LOGJIKËN TONË

Duke përshtatur një ushtrim 2400-vjeçar me teknologjitë e sotme, studiuesit tregojnë se një model i inteligjencës artificiale nuk rikthen vetëm njohuritë. Ai eksploron, dështon dhe më pas rregullon përgjigjet e tij si një student.

Që nga kohërat e lashta, matematika është përdorur për të hetuar kufijtë e inteligjencës njerëzore. Në çdo epokë, enigmat e tyre janë vënë në shërbim të një kërkimi më të madh, atij të të kuptuarit të arsyetimit. Sot, kjo ambicie shtrihet përmes makinerive, të thirrura për të zgjidhur problemet që filozofët përdornin për të trajnuar mendjen. Njëra prej tyre, nga dialogu i Platonit, zbulon të metat dhe premtimet e arsyetimit matematikor të ChatGPT.

NJË ENIGMË NGA ANTIKITETI PËR TË TESTUAR INTELIGJENCËN E MAKINERIVE

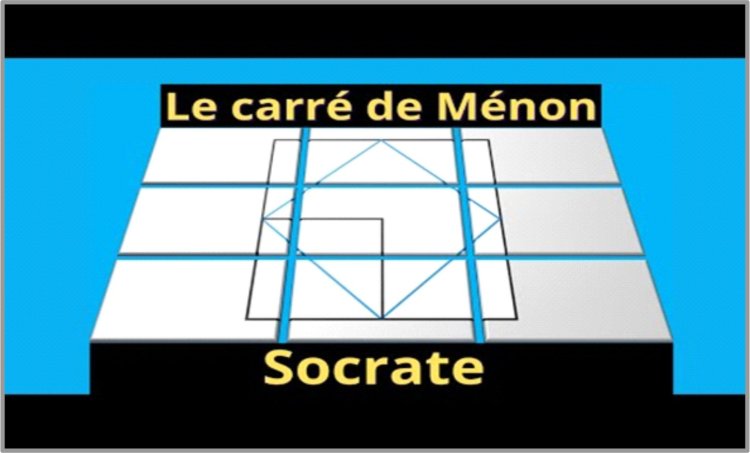

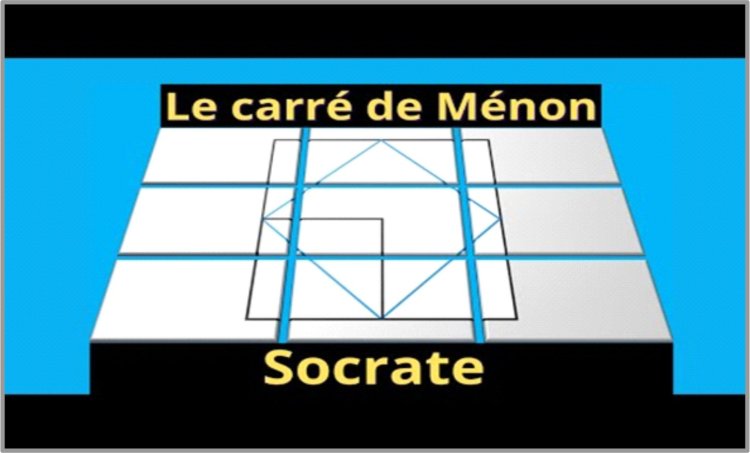

Gjithçka fillon me një pyetje që është më shumë se dy mijëvjeçarë e vjetër. Në dialogun e Platonit Meno, Sokrati përballet me një skllav të ri me një problem në dukje të thjeshtë. Ai përfshin dyfishimin e sipërfaqes së një katrori pa katërfishuar madhësinë e tij. Djali fillimisht përpiqet të dyfishojë gjatësinë e anëve, dështon dhe më në fund zbulon, i udhëhequr nga Sokrati, se diagonalja e katrorit origjinal bën të mundur marrjen e një figure të re, sipërfaqja e së cilës është saktësisht e dyfishuar. Ky pasazh themelor ka nxitur prej kohësh debatin filozofik mbi origjinën e dijes.

Për Nadav Marco, një studiues vizitor në Universitetin e Kembrixhit, dhe Andreas Stylianides, profesor i didaktikës së matematikës, ky problem i vjetër ishte terreni ideal për të vënë në dyshim funksionimin e modeleve të mëdha gjuhësore. Qëllimi i tyre nuk ishte të testonin kujtesën e papërpunuar të inteligjencës artificiale, por të zbulonin nëse ajo mund të mobilizonte një formë të logjikës autonome kur nuk dukej një përgjigje e qartë. Studimi i tyre, i botuar në International Journal of Mathematical Education in Science and Technology, është frymëzuar drejtpërdrejt nga eksperimenti i përshkruar nga Platoni për të vëzhguar një formë tjetër studenti, pa trup ose vetëdije.

ARSYETIMI MATEMATIKOR I CHATGPT PËRBALLË NJË NGËRÇI GJEOMETRIK

Eksperimenti përfshinte bërjen e ChatGPT-4 të së njëjtës pyetje si Sokrati, duke ndryshuar pak formulimin ndërsa biseda përparonte. Nga përgjigjet e para, studiuesit vunë re një sjellje befasuese. Në vend që të përsëriste zgjidhjen e njohur që përfshin diagonalen, chatbot zgjodhi një metodë algjebrike të bazuar në llogaritjen e rrënjëve katrore. Ai shmangu gabimin e djalit të Platonit, por pa iu drejtuar gjeometrisë. Kjo strategji thjesht llogaritëse dukej se binte ndesh me praninë, sado e provuar, të zgjidhjes gjeometrike në të dhënat e trajnimit të modelit.

Zgjedhja e chatbot-it, e ndikuar kryesisht nga trajnimi i tij nga tekstet dhe jo nga imazhet, tregon kufijtë e tij sapo arsyetimi shkon përtej kornizës simbolike. Siç përmblidhet nga Livescience, kjo paragjykim tekstual çon në një preferencë për qasjet algjebrike, edhe kur situata sugjeron një përgjigje grafike më elegante. Studiuesit më pas u përpoqën të ridrejtonin dialogun, duke shprehur zhgënjimin e tyre me këtë zgjidhje të përafërt. Ky koment i thjeshtë ishte i mjaftueshëm për të shkaktuar një përmbysje të strategjisë. ChatGPT më pas propozoi ndërtimin e katrorit në diagonale, duke demonstruar se me të vërtetë e dinte përgjigjen e pritur.

Ky tranzicion ngre një pyetje kyçe. A përfundoi AI thjesht duke kujtuar metodën e duhur apo ndryshoi arsyetimin e saj në përgjigje të një konteksti të ri? Përgjigja mbetet e pasigurt. Megjithatë, siç thekson Universiteti i Kembrixhit në njoftimin e tij për shtyp, aftësia e mjetit për të përmbysur gabimet e tij dhe për të përmirësuar logjikën e tij evokon sjelljen e një studenti në mes të një zone zhvillimi.

KUR GABIMI BËHET NJË DRITARE NË MËSIMIN E MAKINERIVE

Duke e komplikuar problemin, studiuesit kanë marrë përgjigje edhe më zbuluese. Kur erdhi puna për dyfishimin e sipërfaqes së një drejtkëndëshi duke ruajtur përmasat e tij, chatbot zgjodhi përsëri një metodë algjebrike. Pastaj, pas disa kujtesave, ai gabimisht pretendoi se nuk ekzistonte asnjë zgjidhje gjeometrike për këtë rast. Ky gabim, sipas autorëve të studimit, ndoshta nuk ishte për shkak të të dhënave të tij të trajnimit. Përkundrazi, ajo bazohej në arsyetim të përafërt, të ndërtuar mbi përgjithësime të gabuara.

Kjo lloj ngathtësie nuk është pa interes. Ai tregon se mjeti jo vetëm që përsërit atë që ka parë tashmë, por përpiqet të zgjidhë pyetjet duke mobilizuar strategjitë e brendshme. Me pak fjalë, arsyetimi matematikor i ChatGPT nuk është i vendosur në gur. Luhatet sipas formulimeve, përmirësohet me ndihmën e një bashkëbiseduesi, ndonjëherë korrigjohet dhe shpesh bën gabime. Kjo sjellje evokon "zonën proksimale të zhvillimit", një koncept arsimor që i referohet asaj që një nxënës nuk mund të arrijë vetëm, por ka sukses me ndihmë.

Për studiuesit, kjo fushë mund të bëhet një levë e re arsimore. Chatbot mund të shërbejë si një thikë me dy tehe, po aq e aftë të mashtrojë sa të stimulojë reflektimin. Me kusht që ata të jenë të vetëdijshëm për kufizimet e tij, mësuesit mund ta përdorin atë për të forcuar të menduarit kritik dhe verifikimin e provave. Siç na kujton Stylianides në deklaratën e tij, studentët duhet të mësojnë të vënë në dyshim arsyetimin e prodhuar nga AI, sepse nuk është aq i mirë sa demonstrimet rigoroze të një libri shkollor matematike.

Nën ajrin e tij të rremë të një arsyetuesi të lashtë, ChatGPT vepron si një pasqyrë e papërsosur e marrëdhënies sonë me dijen. Ai mëson nga përafrimi, përparon me provë dhe gabim, dështon me panache dhe ndonjëherë ia del në befasi, ashtu si studentët që mund të shoqërojë një ditë.

Përktheu Ismail Ismaili